Ada konsep lama di AI namanya "World Models," yang lagi naik daun banget sekarang.

Intinya, "World Models" itu kayak "peta mental" internal yang dimiliki AI buat ngeramal apa yang bakal terjadi kalo dia ngelakuin sesuatu.

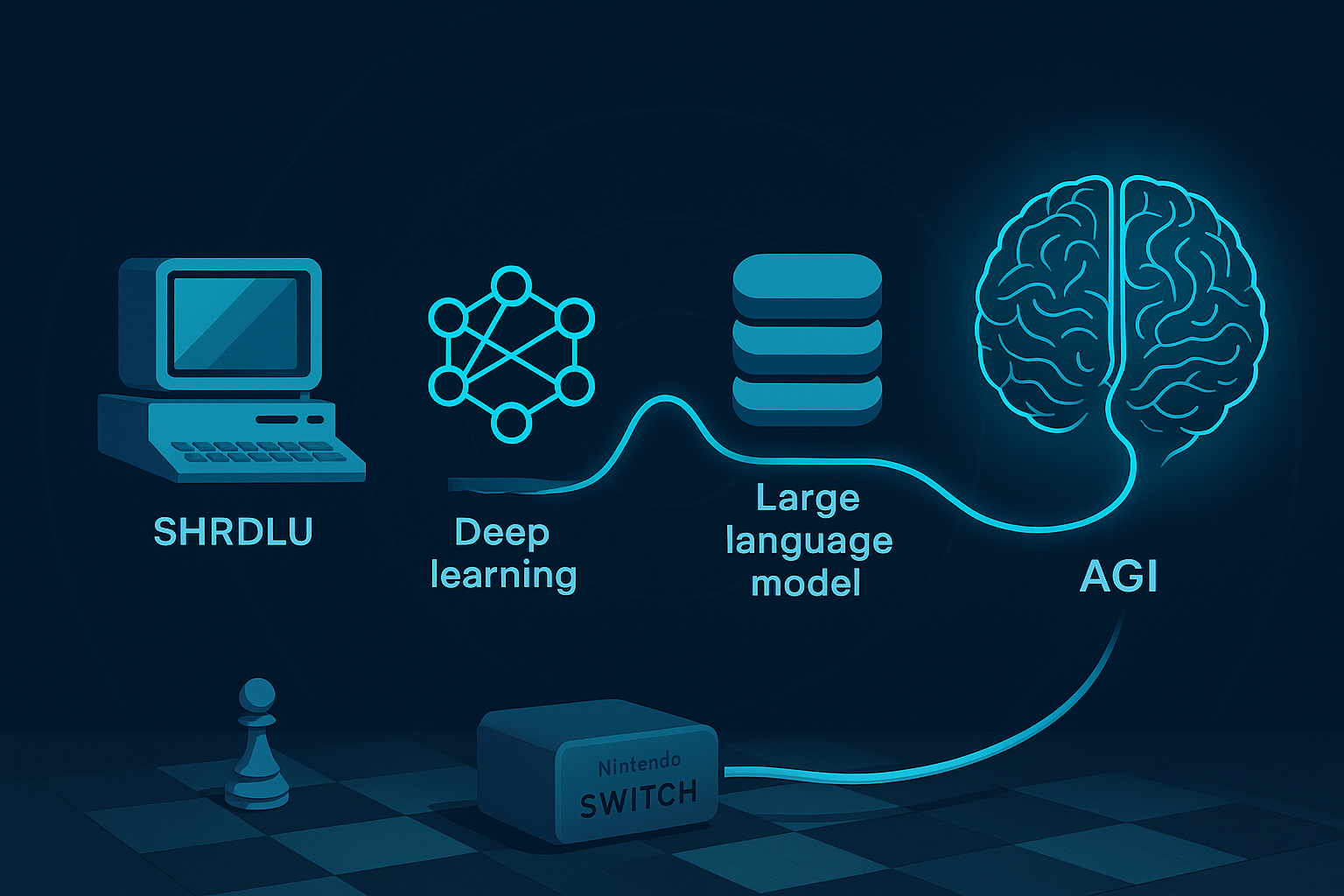

Konsep ini udah ada dari tahun 1943, terus dipake di AI jadul kayak SHRDLU. Tapi sempat ada yang bilang, "ngapain bikin model, dunia itu sendiri udah paling bagus jadi modelnya."

Makanya sempat ditinggalin. Nah, sekarang gara-gara deep learning, ide ini balik lagi. Neural network bisa belajar "ngeramal" kejadian lewat coba-coba. Cuma ya, LLM kita yang sekarang (kayak ChatGPT gitu) itu, walau pinter banget, analisanya bilang kayak "kumpulan trik" doang, bukan model dunia yang utuh.

Kayak orang buta nyentuh gajah, cuma kebagian sedikit-sedikit doang. Tapi anehnya, pengetahuan parsial ini bisa bikin mereka melakukan hal keren, kayak ngasih petunjuk navigasi Manhattan tanpa peta.

Para suhu AI kayak LeCun, Hassabis, Jenop, sampe Hinton itu setuju, kalau mau bikin AI yang beneran pinter (AGI), yang aman dan bisa dipercaya, kita butuh "World Models" yang solid.